L'algoritmo che decide chi assumere non sa cos'è un pregiudizio.

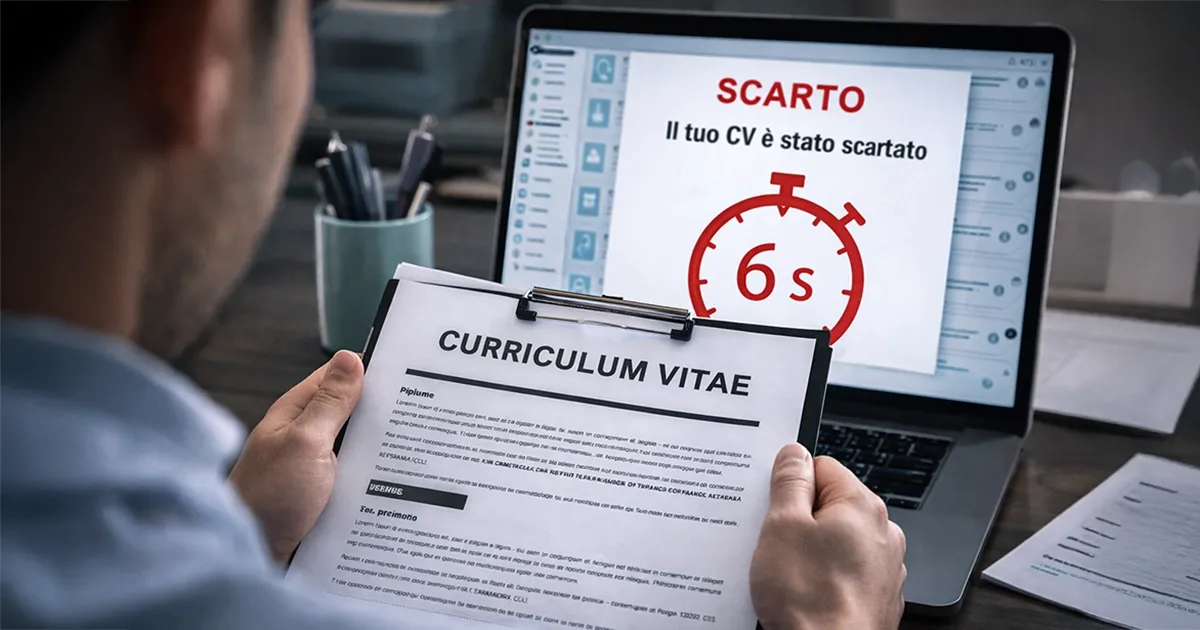

Sei secondi. È il tempo che un software impiega a decidere se il tuo CV merita di essere letto. Il 97% delle Fortune 500 usa sistemi ATS per filtrare candidati. Il problema non è l'efficienza: è che nessuno audita i criteri.

Sei secondi. È il tempo che un software impiega a decidere se il tuo CV merita di essere letto da un essere umano.

Un curriculum viene inviato per una posizione aperta. Esperienza allineata, competenze pertinenti, lettera motivata. Non arriva risposta. Nemmeno un rifiuto automatico. Il CV non è mai stato letto da un essere umano. È stato scartato da un software in sei secondi.

Il candidato pensa di non essere abbastanza. La verità è più semplice: il suo CV non conteneva le parole chiave che il filtro cercava.

ATS e screening automatico: come funziona il filtro che scarta i CV

I sistemi ATS, Applicant Tracking System, gestiscono il flusso di candidature prima che un recruiter le veda. Secondo Jobscan, oltre il 97% delle aziende Fortune 500 li usa. Molte PMI li adottano attraverso piattaforme di recruiting che li integrano di default, spesso senza sapere cosa fanno.

Il software analizza il testo del CV. Cerca corrispondenze con la job description: titoli di studio, certificazioni, nomi di tecnologie, anni di esperienza espressi in formato numerico. Assegna un punteggio. I curricula sotto una certa soglia vengono eliminati. Quelli sopra passano a un umano.

Un CV formattato in modo non standard, con tabelle, colonne, grafici, può essere letto male dal parser e scartato anche se il contenuto è perfetto. Un percorso non convenzionale, senza le keyword giuste, non supera il filtro. Un cambio di settore, una pausa lavorativa, un'esperienza all'estero con titoli non riconosciuti: ostacoli invisibili, non per il recruiter, ma per il software che il recruiter non sa nemmeno di avere.

Il caso Amazon: quando l'algoritmo ha imparato a discriminare

Nel 2018 Reuters ha pubblicato un'inchiesta su un sistema di AI che Amazon aveva sviluppato per lo screening dei curricula. L'idea: addestrare un modello su dieci anni di assunzioni passate per identificare i candidati migliori. Dieci anni di assunzioni nel settore tech di Amazon significavano dieci anni di assunzioni prevalentemente maschili.

Il modello ha trovato pattern. Il pattern era che i candidati selezionati erano uomini. Ha iniziato a penalizzare i curricula che contenevano la parola "women's", come in "women's chess club" o "women's college". Non per misoginia. Per matematica. I dati storici contenevano il pregiudizio, il modello lo ha codificato, il risultato era discriminazione con la coerenza di una catena di montaggio.

Amazon ha dismesso il sistema. Ma lo ha fatto perché Reuters ha raccontato la storia e la pressione pubblica è diventata insostenibile. La domanda che resta: quante aziende usano strumenti simili senza avere le risorse, la volontà o la visibilità mediatica per verificare cosa succede dentro? Il modello è stato smontato in quel caso specifico. In migliaia di altri, gira silenziosamente.

L'obiezione legittima: anche i recruiter hanno pregiudizi

Il recruiting umano non è meglio. Studi del National Bureau of Economic Research hanno mostrato che curricula identici ricevono tassi di risposta diversi a seconda del nome del candidato. Un nome che "suona" afroamericano ottiene meno callback di uno che "suona" bianco. Senza algoritmi, senza AI. Solo un recruiter, una pila di CV e i suoi pregiudizi inconsci.

L'obiezione è razionale: almeno un algoritmo è coerente. Non ha avuto una brutta giornata. Non cambia metro di giudizio tra le nove di mattina e le cinque di pomeriggio.

È vero. Ed è il problema.

Un umano con i suoi bias puoi confrontarlo. Puoi mettergli davanti i dati. Puoi fargli cambiare idea, o almeno provarci. Un algoritmo discrimina con la stessa precisione con cui ordina una lista alfabetica. E lo fa con l'apparenza della neutralità, che trasforma un pregiudizio contestabile in un processo aziendale documentato, approvato, difeso come "oggettivo".

Il costo nascosto dell'automazione nelle assunzioni

Quando un'azienda dice "usiamo l'AI per rendere il processo di selezione più oggettivo", sta prendendo i pregiudizi contenuti nei dati storici e li sta rivestendo di neutralità tecnologica. L'AI non ha inventato la discriminazione nel recruiting. L'ha ereditata. Ma le ha dato qualcosa che prima non aveva: l'invisibilità.

Il talento perso non è misurabile. Non esiste una metrica per le persone brillanti filtrate via perché il loro percorso non rientrava nei pattern. Non esiste un KPI per le competenze non convenzionali che un parser ha ignorato. Esiste solo l'efficienza: tempo risparmiato, costi ridotti, processo scalabile. L'efficienza si misura. L'ingiustizia no.

In Europa il Regolamento sull'Intelligenza Artificiale, approvato nel 2024, classifica i sistemi di AI usati nel recruiting come "ad alto rischio". Obblighi di trasparenza, documentazione, supervisione umana. Tra la norma e la pratica c'è un oceano. Ci vorranno anni prima che la compliance diventi reale. Nel frattempo, ogni giorno, curricula vengono scartati in sei secondi da sistemi che nessun candidato sa di dover superare.

Un pregiudizio umano lo puoi contestare guardando qualcuno negli occhi. Un pregiudizio trasformato in processo aziendale automatizzato non ha occhi. Ha solo un punteggio, una soglia e il silenzio di chi non riceve nemmeno un "grazie, le faremo sapere". Esiste un'industria di consulenti che insegnano a scrivere curricula per le macchine, non per le persone. Il fatto che questa industria esista dice tutto su chi comanda il processo.