Fai una domanda a ChatGPT. Ottieni una risposta fluida, articolata, convincente. La usi. Non verifichi. Domani ne farai un'altra. Anche quella non la verificherai. Ti sei mai chiesto a chi stai credendo?

ChatGPT e la domanda che non fai mai

Quando il tuo commercialista ti dice che puoi dedurre una spesa, sai una cosa: se sbaglia, risponde. Ha un nome, un ordine professionale, un'assicurazione, una reputazione da proteggere. Se il tuo medico prescrive un farmaco sbagliato, esiste un percorso: reclamo, perizia, tribunale. Non lo usi quasi mai ma esiste. E il fatto che esista cambia tutto, perché cambia il modo in cui il medico ti parla.

Ora pensa all'ultima volta che hai chiesto qualcosa a un'AI generativa. Ti ha risposto con lo stesso tono sicuro del commercialista. Forse più sicuro. Nessuna esitazione, nessun "dovrei verificare", nessun "nel tuo caso specifico potrebbe essere diverso". Una risposta liscia, completa, autorevole.

A chi la contesti se è sbagliata?

Cognitive surrender: la resa che non vedi

Ad aprile 2026, Ars Technica ha documentato un fenomeno che i ricercatori chiamano "cognitive surrender": utenti che abbandonano il proprio ragionamento logico e accettano risposte errate dall'AI. Non per stupidità. Per architettura del rapporto.

Soffermati su questa parola: resa. Non distrazione, non fretta, non superficialità. Resa. Significa che il tuo apparato critico si spegne. Non perché sei pigro ma perché stai interagendo con qualcosa che ha tutte le caratteristiche formali dell'autorità (competenza apparente, sicurezza espositiva, ampiezza di conoscenza) e nessuna delle caratteristiche sostanziali (responsabilità, contestabilità, crescita nel dialogo).

È una combinazione mai incontrata prima. Il professore universitario più arrogante del mondo può essere incalzato. Puoi alzare la mano e dire "non sono d'accordo e le spiego perché". Lui può rispondere male, può ignorarti, può darti un voto basso. Ma il dialogo è possibile. L'AI non può essere incalzata. Puoi scrivere "sei sicuro?" e otterrai una riformulazione dello stesso contenuto con qualche caveat in più. Non è dialogo, è un'altra erogazione.

AILD ritirata e AI Act: otto anni di vuoto normativo

Nel febbraio 2017, il Parlamento europeo ha chiesto alla Commissione di valutare uno status giuridico per i robot più sofisticati, le cosiddette "persone elettroniche", potenzialmente responsabili dei propri atti. Nel settembre 2022, la Commissione ha presentato una proposta di direttiva sulla responsabilità civile dell'intelligenza artificiale, la AILD. Sembrava un percorso lineare: la tecnologia avanza, il diritto la insegue, prima o poi la raggiunge.

Nel febbraio 2025, la Commissione ha ritirato quella proposta. Motivazione: nessun accordo prevedibile fra legislatori UE e Stati membri e il rischio di sovraregolazione che pesa sulla competitività europea.

Otto anni. Dal 2017 al 2025. Dal "creiamo una persona elettronica responsabile" al "non riusciamo nemmeno a metterci d'accordo su chi paga i danni". Nel frattempo l'AI Act (Regolamento UE 2024/1689) è entrato in vigore con un approccio basato sui rischi e l'Italia si è dotata della legge 132/2025, primo tentativo nazionale di inquadrare l'intelligenza artificiale. Ma come ha osservato Anna Romano dello Studio Satta Romano & Associati, «il suo impianto rimane ancora incompleto e la mancata creazione di un'autorità unica lascia aperti interrogativi rilevanti sulla tenuta del sistema di vigilanza».

La vigilanza è stata distribuita su una pluralità di autorità preesistenti: AgID e ACN come architrave designato dalla 132, sovrapposizioni con Garante Privacy e AGCOM, competenze settoriali per Banca d'Italia, CONSOB, IVASS quando l'AI tocca finanza e assicurazioni. Una «frammentazione delle competenze», la definisce Romano, «sicuramente una scelta discussa e criticabile». Tradotto: se l'AI del tuo gestionale ti dà un'informazione sbagliata e ci perdi soldi, buona fortuna a capire a quale autorità rivolgerti.

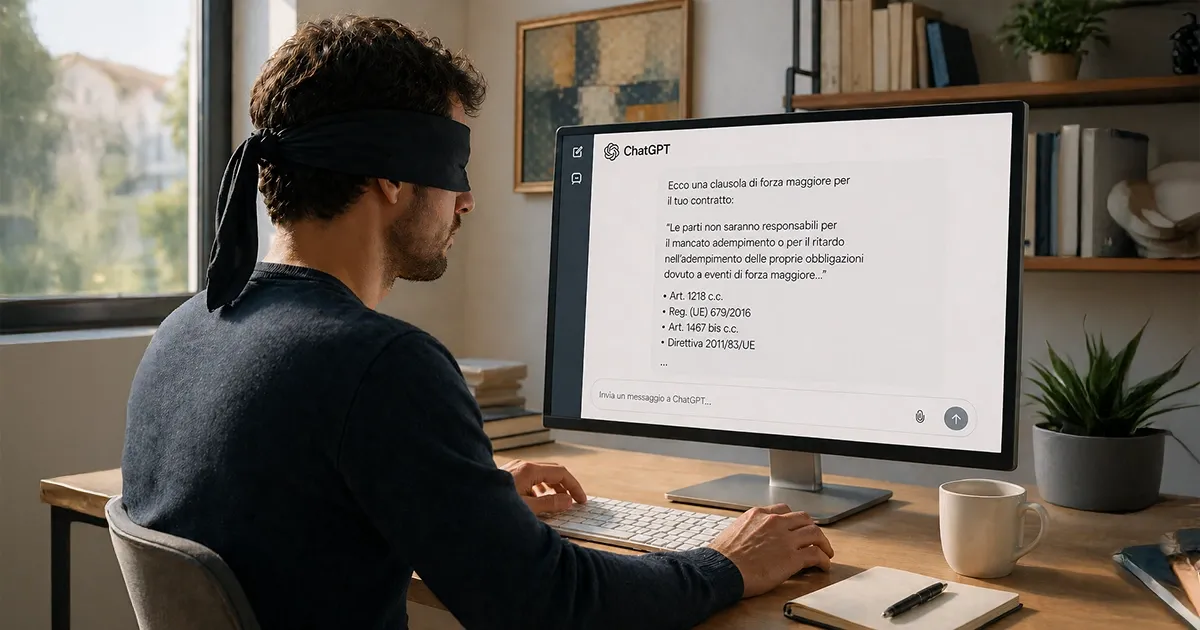

Qualche tempo fa un cliente, una piccola azienda manifatturiera, mi ha "confessato" che aveva usato ChatGPT per redigere le clausole di forza maggiore di un contratto con un fornitore estero. Le clausole sembravano perfette: linguaggio fluido, struttura professionale, riferimenti normativi precisi. Peccato che due di quei riferimenti normativi non esistessero. Inventati di sana pianta, con numeri di articolo e tutto. Il cliente lo ha scoperto solo perché l'avvocato, quello in carne e ossa, ha controllato prima della firma. Se non avesse controllato? A chi avrebbe contestato quelle clausole fantasma?

Fiducia nel medico vs fiducia nell'AI

"Ma anche col medico non verifico tutto. Mi fido e basta."

Vero, la delega acritica agli esperti umani esiste, è quotidiana, è fisiologica. Non interroghi ogni prescrizione. Non chiedi al notaio di mostrarti il fondamento giuridico di ogni clausola. Accetti, firmi e vai avanti.

La differenza non sta nella tua condotta. Sta nella struttura del rapporto. Il medico, che sbagli o no, opera dentro un sistema che prevede la possibilità di essere chiamato a rispondere. Questa possibilità, anche quando non la eserciti, plasma il modo in cui l'autorità si comporta. Il medico sceglie le parole con cura perché sa che quelle parole possono essere riesaminate. Il consulente mette per iscritto perché sa che lo scritto è un impegno.

L'AI non opera in nessun sistema di questo tipo. Non sceglie le parole con cura: le genera con probabilità statistica. Non teme conseguenze: non può temerle. Non impara dalla tua contestazione: ricalcola.

Bernard Stiegler lo aveva intuito ragionando sulla tecnica come "farmaco": ogni strumento è insieme cura e veleno e la differenza la fa il regime di responsabilità in cui lo inserisci. Un bisturi in mano a un chirurgo è una cura perché il chirurgo risponde. Lo stesso bisturi senza nessuno che risponde è solo una lama.

Autorità senza rendimento di conto: cosa cambia rispetto al passato

Se accetti questo ragionamento, perdi qualcosa. Perdi la comodità di trattare l'AI come un oracolo efficiente. Ogni volta che ricevi una risposta devi chiederti: su cosa poggia? chi ne risponde? cosa succede se è sbagliata? Questo rallenta. È un costo che senti subito. Significa che il vantaggio di velocità che l'AI ti dà viene in parte eroso dal lavoro di verifica che devi fare tu.

Non ti sto dicendo di smettere di usare questi strumenti. Ti sto dicendo che il rapporto in cui sei entrato non ha precedenti nella forma specifica che assume. Sì, oracoli, astrologi e propaganda statale hanno esercitato autorità cognitiva senza accountability per millenni. Ma avevano una caratteristica che l'AI non ha: erano lenti. Potevi sottrarti, potevi confrontarti con chi la pensava diversamente, potevi lasciare che il dubbio maturasse. L'AI ti risponde in due secondi, su qualsiasi domanda, con la stessa sicurezza. Non ti dà il tempo di dubitare. E lo fa miliardi di volte al giorno, su scala che nessun oracolo ha mai sfiorato.

Quando smetti di pretendere il «non lo so»

Autorità senza rendimento di conto. Tienila a mente la prossima volta che accetti una risposta generata. Non per smettere di usare l'AI ma per ricordarti che stai interagendo con qualcosa che ha il tono dell'esperto e la struttura del distributore automatico: eroga ma non risponde.

Ogni volta che ricevi una risposta da un'AI, trattala come tratteresti il consiglio di uno sconosciuto brillante incontrato in treno: interessante, potenzialmente utile, da verificare prima di agire.

Poi c'è ancora un'implicazione meno ovvia: se l'AI è autorità senza rendimento di conto, il problema non è solo che devi verificare le risposte. Il problema è che smetti di fare le domande difficili. Quelle a cui un esperto umano risponderebbe "non lo so, devo approfondire". L'AI non dice mai "non lo so". E tu, piano piano, smetti di aspettarti che qualcuno lo dica. Smetti di riconoscere l'onestà del limite. Cominci a scambiare l'assenza di esitazione per competenza. E questo, alla lunga, cambia te più di quanto cambi lo strumento. Usa lo strumento, pretendi da te stesso la verifica e smettila di scambiare la fluidità di una risposta per la sua affidabilità. Chi ti parla bene non è sempre chi ti parla giusto.

Fonti

- Ars Technica, «Cognitive surrender» leads AI users to abandon logical thinking (aprile 2026)

- Commissione Europea, ritiro proposta AILD — Ansa, 12 febbraio 2025

- Regolamento (UE) 2024/1689 — AI Act (2024)

- Legge 23 settembre 2025, n. 132 — Disposizioni e deleghe in materia di intelligenza artificiale

- Garante per la protezione dei dati personali, lettera a Parlamento e Governo sulle Autorità di vigilanza

- Anna Romano (Studio Satta Romano & Associati), «IA, l'esperto: In Italia una legge esiste ma serve autorità ad hoc» — Sky TG24, 5 novembre 2025

Commenti

Solo gli iscritti possono commentare. Iscriviti gratis o accedi con la tua email.