Nel 2019 un cliente mi ha detto una frase che non ho più dimenticato. Sei anni dopo, quella frase spiega esattamente cosa sta succedendo con l’intelligenza artificiale generativa.

Dal cloud all'AI: la delega cognitiva inconsapevole

Nel 2019, lo ricordo bene perché poco dopo arrivò il Covid, un cliente, uno studio professionale di Bologna, mi chiama perché vuole "mettere tutto in cloud". Gli chiedo: cosa vuol dire per te "tutto in cloud"? Silenzio. Poi: "Beh, quello che ci ha proposto il consulente Microsoft. SharePoint, Teams, Exchange. Così non dobbiamo più pensarci."

Così non dobbiamo più pensarci.

Non "così siamo più efficienti". Non "così risparmiamo". Non "così i dati sono più sicuri". Così non dobbiamo più pensarci.

Tempo fa mi richiama. Microsoft ha aumentato i prezzi, ha aggiunto Copilot al pacchetto senza che nessuno lo chiedesse e la fattura annuale era cresciuta sensibilmente. Ma il vero problema non era il prezzo. Il vero problema era che per spostare quei dati da qualche altra parte, per esercitare il suo diritto di andarsene, servivano settimane di lavoro e migliaia di euro.

Aveva delegato la decisione al consulente Microsoft. Che aveva delegato al prodotto Microsoft. Che aveva fatto il suo lavoro: rendere la permanenza comoda e l’uscita costosa.

Quella storia mi è tornata in mente lunedì mattina, quando ho fatto un esperimento.

Cosa succede quando deleghi le decisioni a un chatbot

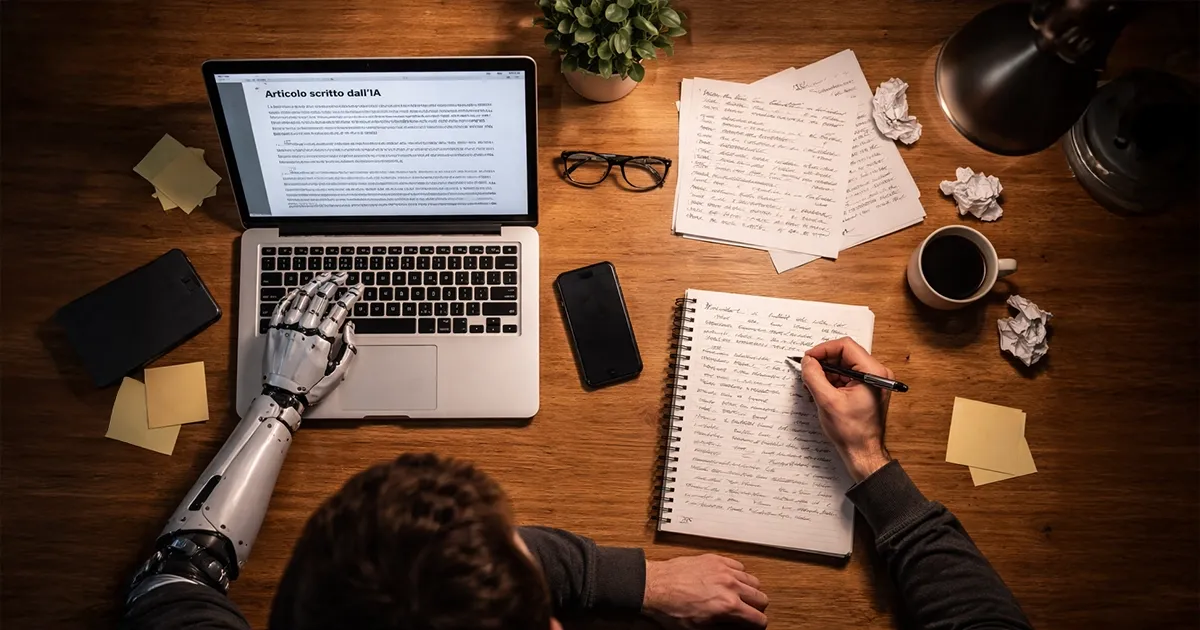

Ho aperto ChatGPT e gli ho dato un brief come lo darei ad un collaboratore. Non due righe buttate lì, un brief serio: target definito, tono specificato, struttura con apertura su caso concreto e chiusura aperta, riferimenti accademici richiesti, vincoli sulla lunghezza, persino l'indicazione di ammettere i limiti della tesi dove esistono.

Trentadue secondi. Millequattro parole. Paragrafi bilanciati, sottotitoli ordinati, chiusura con call-to-action. Tutto perfetto.

L’ho letto. Poi l’ho riletto ancora. E ho riconosciuto lo schema.

Non c'era niente di sbagliato. Ma non c'era niente di mio. Nessun dubbio. Nessuna esitazione. Nessun momento in cui il ragionamento cambia direzione perché ti accorgi che la prima intuizione era sbagliata. Il caso concreto di apertura era plausibile ma non era successo. Il riferimento a Kahneman era pertinente ma decorativo, messo lì perché l'avevo chiesto, non perché serviva all'argomento. Era un testo che diceva le cose giuste nel modo giusto, senza averle mai pensate.

Era lo stesso meccanismo del mio cliente del 2019. Un risultato che sembra buono, che toglie la fatica, che ti fa dire: così non devo più pensarci. E come il cloud del consulente Microsoft, il problema non è quello che ti dà. È quello che ti toglie senza che te ne accorga.

Delega cognitiva: il rischio per professionisti e PMI

Qualcuno a questo punto pensa: sì, ma se il risultato funziona, che importa chi l'ha prodotto?

Importa. Chiedete alla redazione de La Provincia di Civitavecchia.

Ottobre 2025. Il quotidiano pubblica in taglio alto un pezzo sulla cronaca locale. Sviluppo in terza pagina. Chi arriva in fondo legge una chiusa che stona parecchio: "Vuoi che lo trasformi in un articolo da pubblicare su un quotidiano (con titolo, occhiello e impaginazione giornalistica) o in una versione più narrativa da magazine d'inchiesta?" La frase di risposta di ChatGPT, lasciata dentro per errore. Copia, incolla, stampa, edicola. Nessuno ha riletto.

Il pezzo è diventato virale. La figuraccia è finita su Open, sui social, ovunque. Un giornale, il cui mestiere è verificare le informazioni, aveva pubblicato un testo senza nemmeno leggerlo fino in fondo.

Questo è il danno specifico della delega cognitiva. Non è che l'AI scrive male. È che scrive plausibilmente, il che è peggio. Un testo scritto male lo correggi. Un testo che sembra giusto lo mandi avanti. E quando il tuo pensiero non è passato attraverso il problema, non hai gli anticorpi per riconoscere l'errore, nemmeno quando l'errore è una frase di ChatGPT stampata nero su bianco in terza pagina.

Il meccanismo sotto

Nel 2008, Nicholas Carr ha pubblicato su The Atlantic un saggio dal titolo “Is Google Making Us Stupid?”. La tesi: ogni volta che deleghiamo un’operazione cognitiva a uno strumento, il muscolo che serviva per quell’operazione si atrofizza. Non è una metafora, è neuroplasticità. Il cervello si ricabla attorno alle scorciatoie che usa di più.

L’AI generativa è la scorciatoia definitiva: ti dà la risposta istantanea, plausibile, rassicurante. E la parte di te che dovrebbe verificare, dubitare, approfondire, si spegne.

In psicologia dell’aviazione lo chiamano automation bias: i piloti si fidano dello strumento anche quando è sbagliato, perché il costo cognitivo di dubitare è più alto del costo di fidarsi. Il mio collega con l’analisi di mercato ha fatto esattamente questo: il costo di rileggere criticamente era più alto del costo di fidarsi. Fino a quando non lo è stato più.

Ora, il parallelo con il cloud del mio cliente 2019 è suggestivo, ma va fatto con onestà: sono fenomeni diversi. Il lock-in cloud è contrattuale: ti tiene dentro con costi di uscita, formati proprietari, dipendenza dall’ecosistema. Lo vedi sulla fattura, se guardi. La delega cognitiva all’AI è più subdola: non c’è una fattura che cresce, c’è un muscolo che si atrofizza. Non ti accorgi di aver perso qualcosa finché non ti serve e scopri che non c’è più. Ma il filo comune è lo stesso: la comodità come meccanismo di cattura. Thaler e Sunstein lo chiamerebbero un nudge : il pulsante "Genera con AI" è la spinta gentile definitiva. Perché pensarci tu quando il bottone è lì, luminoso, invitante, a un clic di distanza?

Come usare l'AI senza perdere il controllo

Uso l’AI ogni giorno. Non sono un luddista che scrive a mano sulla pergamena.

Nella mia azienda l’AI è integrata nei flussi di lavoro: formattazione di documenti, analisi di log, generazione di bozze di codice, refactoring, debug. Ci fa risparmiare ore ogni settimana. Quando devo convertire un file, pulire un dataset, formattare un report, l’AI è uno strumento straordinario e sarebbe stupido non usarla.

Ma c’è una linea e la traccio così: uso l’AI per eseguire, non per decidere.

Se devo scrivere un’email importante a un cliente, la scrivo io. Posso chiedere all’AI di controllare il tono, accorciare una frase, verificare un dato. Ma il contenuto (cosa voglio dire, cosa ometto, quale peso dare a quale argomento) quello passa attraverso la mia testa. Perché quel contenuto dipende dalla relazione con quel cliente specifico, dalla storia che abbiamo, dal problema che ha davanti. Cose che nessun modello linguistico conosce.

Se devo preparare un’analisi per una migrazione, l’AI mi aiuta a raccogliere dati, confrontare opzioni, strutturare il documento. Ma la valutazione (questo cliente è pronto? Ha le risorse interne? Il gioco vale la candela?) quella è mia. Perché se sbaglio, la responsabilità è mia. E se non ho pensato il problema, non sono in grado di difendere la soluzione.

La domanda che mi faccio ogni volta è semplice: sto usando l’AI come un cacciavite o come un pilota automatico? Il cacciavite fa quello che gli dico. Il pilota automatico decide per me. Finché è un cacciavite, va bene. Quando diventa pilota automatico, ho un problema.

Non ho la linea definitiva. Si sposta. Ci sono giorni in cui delego troppo e me ne accorgo dopo. Ma la domanda me la faccio e questo, credo, è il punto.

Cosa c’entra con te

Se hai uno studio, un’azienda, una partita IVA: il rischio non è che l’AI ti rubi il lavoro. Il rischio è che ti rubi il pensiero e che tu non te ne accorga perché il risultato sembra buono.

Un testo scritto dall’AI è corretto. Una strategia suggerita dall’AI è plausibile. Un’analisi generata dall’AI è presentabile. Ma nessuna di queste cose è passata attraverso la tua esperienza, i tuoi errori, il tuo modo specifico di guardare le cose.

E quando il tuo pensiero è uguale a quello di chiunque altro usi lo stesso strumento, che valore porti al tavolo?

Il reframing

Ho cancellato l’articolo scritto da ChatGPT e ho aperto un editor vuoto. Mi ci è voluta un’ora buona invece di trenta secondi. Ho cambiato idea due volte sulla struttura. Ho tagliato un paragrafo intero che non funzionava. Ho aggiunto l’aneddoto del cliente del 2019 che inizialmente non c’era.

Il risultato è questo testo. Che non è perfetto. Nessun testo lo è quando lo scrive un essere umano che dubita. Ma è mio. E le imperfezioni, i cambi di rotta, i dubbi che ho lasciato visibili: sono esattamente il valore.

La prossima volta che il cursore lampeggia su uno schermo bianco e la tentazione è premere "Genera", chiediti: saprei spiegare a voce, adesso, cosa voglio dire?

Se la risposta è sì, l’AI può aiutarti a dirlo meglio, più veloce, più pulito. Usala.

Se la risposta è no, il problema non è la velocità. È che non hai ancora pensato. E nessuna macchina può farlo al tuo posto.

Commenti

Solo gli iscritti possono commentare. Iscriviti gratis o accedi con la tua email.